Harvard Üniversitesi'ndeki bir grup teorik fizikçi, modern yapay zeka uygulamalarının matematiksel temelini aydınlatan önemli bir çalışma gerçekleştirdi. Araştırmanın bulguları, sinir ağlarının başarısının, rastgele etkenlere değil, katı fiziksel ilkelere dayandığını ortaya koyuyor.

Yapay Zeka ve Fiziksel Yasalar

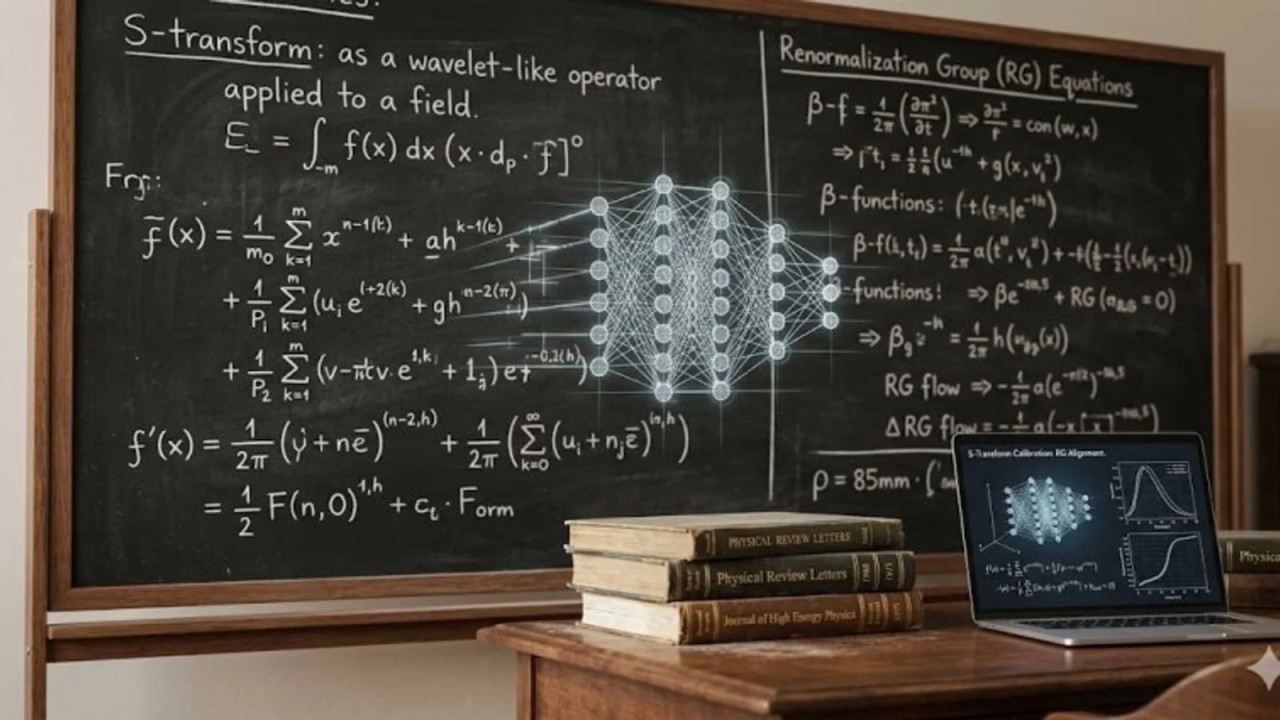

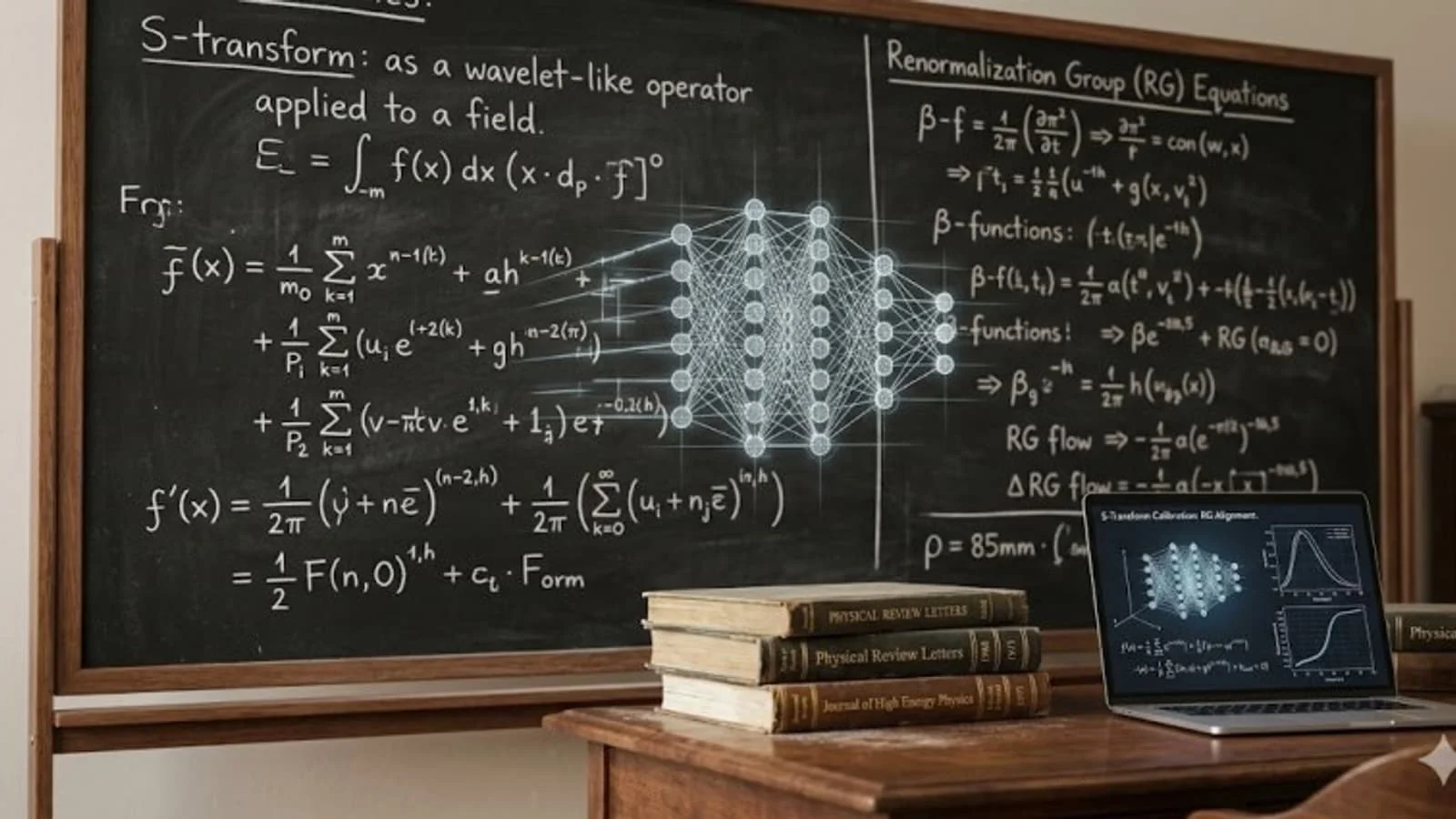

Uzmanlar, sinir ağlarının eğitim süreçlerini karmaşık fizik sistemleri ile karşılaştırarak, makine öğreniminde «ölçeklendirme yasaları» konusunda temel istatistiksel mekanik ile bağlantıları ortaya koymuşlardır. Araştırmada, kuantum alan teorisinden esinlenilen «yeniden normalleştirme» kavramı önemli bir yere sahip. Bu kavram, model parametrelerinin, temel parçacık fiziğindeki kuantum dalgalanmaları gibi değiştiğini ortaya koyuyor.

Keşiflerin Uygulamaları

Araştırma süresince elde edilen bulgulardan biri, sinir ağlarının eğitim hatası ile test hatası arasındaki ilişkiyi belirleyen matematiksel denklemlerin türetilmesi olmuştur. Bu yeni bilgi, pahalı test süreçlerine gerek kalmadan bir sinir ağının kalitesinin eğitim verilerine dayanarak tahmin edilmesini sağlar. Ayrıca, sinir ağlarının dört farklı çalışma modunun varlığı keşfedildi ve bu, mühendislerin model oluşturma sürecini daha öngörülebilir hale getirmeye yardımcı olmaktadır.

- Matematiksel «S-dönüşümü» yöntemi ile eğitim ve test hatası ilişkisi belirlenmiştir.

- «Başlatma engeli» kavramı, bir sinir ağının boyutunu artırmanın her zaman verimli olmadığını göstermektedir.

- Doğru başlangıç parametrelerinde rastgelelik, modelin daha fazla büyütülmesini anlamsız hale getirebilir.

Çifte Düşüş Fenomeni

Araştırma, makine öğrenimindeki «çifte düşüş» (double descent) fenomenini de açıklamakta; bu fenomen, modelin «etkili parametrelerinin» veri hacmiyle birlikte değiştiğini göstermektedir. Veri miktarı arttıkça, bu durum sistemin en etkili ve doğru çözümleri bulmasına yardımcı olmaktadır.

“Başlatma engeli, başlangıç parametrelerinin rastgeleliğinin modelin başarısını nasıl etkilediğini vurguluyor. Bu, sinir ağlarını birleştirmek gibi alternatif yöntemleri zorunlu kılabilir.”

Bu araştırmanın bulguları, yapay zeka alanında ilerlemeyi destekleyici yönde önemli katkılarda bulunarak, model tasarımını daha sistematik bir süreç haline getirmektedir.

Haberin Editörü: Emre ALADAĞ

İlk yorumu sen yap! Düşüncelerini bizimle paylaş.